RAG-Sprachmodell – Demonstrator für spezifische Anwendungsfälle in Unternehmen

Der RAG-Sprachmodell-Demonstrator bietet einen potenziellen Lösungsansatz, wie kleine und mittlere Unternehmen (KMU) KI-Sprachmodelle für spezifische Anwendungsfälle einsetzen können. Mit RAG-Sprachmodellen können Unternehmen maßgeschneiderte KI-Lösungen lokal einsetzen, ohne den hohen Energieverbrauch von Standard-Sprachmodellen und ohne auf externe Anbieter zurückgreifen zu müssen. Der Demonstrator vergleicht die Ergebnisse eines Standard-Sprachmodells mit einem Sprachmodell, dass durch RAG (Retrieval-Augmented Generation) erweitert wurde.

Hier finden Sie den RAG-Sprachmodell-Demonstrator auf GitHub.

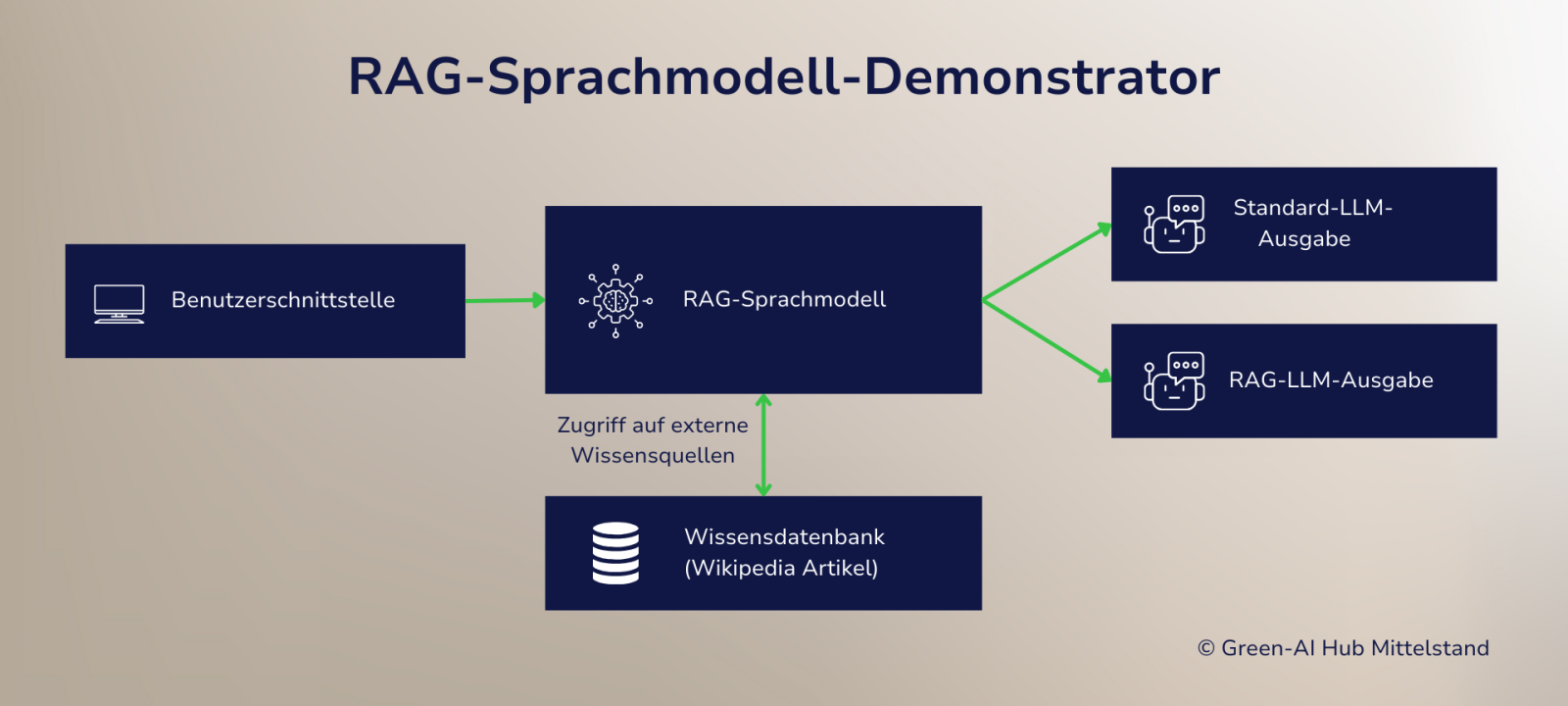

Grafik 1: Schematische Darstellung des RAG-Sprachmodell-Demonstrators.

Herausforderung: Sprachmodelle, Energieverbrauch und Zugänglichkeit

KI-Sprachmodelle (LLMs) bieten für viele Unternehmen potenziell einen erheblichen Mehrwert. Sie lassen sich bspw. dazu nutzen, schnell und einfach per Suche auf relevante Informationen zugreifen zu können. Herkömmliche Sprachmodelle bieten beeindruckende Ergebnisse, erfordern jedoch eine enorme Rechenleistung, was zu einem hohen Energieverbrauch und ökologischem Fußabdruck führt. Ebenso kosten die kundenspezifischen Anpassungen häufig viel Geld, da das gesamte Modell neu trainiert werden muss, was für kleinere und mittlere Unternehmen eine große Hürde darstellt.

Lösung: RAG-erweiterte Sprachmodelle

Der RAG-Sprachmodell-Demonstrator bietet eine Webschnittstelle für den Vergleich der Ergebnisse eines Standard-Sprachmodells mit einem durch RAG (Retrieval-Augmented Generation) erweiterten Sprachmodell. Anstatt alle Informationen im Modell zu speichern, greift RAG auf externe Wissensquellen zu, um relevante Daten in Echtzeit abzurufen. Die Vorteile sind ein wesentlich geringerer Energieverbrauch und leichtere Aktualisierungen der Wissensbasis, da diese unabhängig vom Modell angepasst werden kann. Dadurch können Sprachmodelle effizienter und umweltfreundlicher eingesetzt werden und sind insbesondere für KMU leichter zugänglich. Ein weiterer Vorteil ist, dass das Sprachmodell lokal auf einem gewöhnlichen Computer mit einer 1,5 GB VRAM Grafikkarte eingesetzt werden kann, was neben der Energieeinsparung auch sicherstellt, dass die Daten nicht das Unternehmen verlassen.

Ressourceneinsparung

RAG erweiterte Sprachmodelle bieten gegenüber herkömmlichen Sprachmodellen den Vorteil, dass ihre Datenbasis ergänzt und angepasst werden kann, ohne das ganze Modell neu zu trainieren. Das spart Energie und Ressourcen beim Training der Modelle. Ebenso vereinfacht es die kundenspezifische Anpassung entscheidend, was die Einsatzhürde für Unternehmen senkt.

Nutzung des Demonstrators

Der RAG-Sprachmodell-Demonstrator bietet eine Webschnittstelle für den Vergleich der Ergebnisse eines Standard-Sprachmodells mit einem durch RAG (Retrieval-Augmented Generation) erweiterten Sprachmodell. In einer Eingabemaske können Nutzer*innen per Text dem Sprachmodell eine Anfrage stellen. Das Modell antwortet darauf einmal mit einer LLM-Standardausgabe und einmal mit einer LLM-RAG-Ausgabe. Nutzer*innen können anschließend die Antworten vergleichen. Die RAG-erweiterte Ausgabe sollte präzisere und kontextuell relevantere Antworten geben.

Grafik 2: Darstellung der Eingabemaske, der LLM-Standard-Ausgabe und der RAG-optimierten Ausgabe des Demonstrators.

Funktionen

- RAG-Implementierung unter Verwendung des mps-Backends von Apple oder (zukünftig) cuda für nvidia-GPUs

- Web-Interface für eine einfache Interaktion mit dem RAG-System

- Anpassbare Wissensdatenbank, die ermöglicht, eigene Wikipedia-Artikel hinzuzufügen und abzurufen.

- Vergleich der Leistungsmetriken von einer Standard-LLM und RAG-LLM KI-Lösung.

- Energiesparende Nutzung, da das Sprachmodell auf handelsüblichen Computern betrieben werden kann.

Der RAG-Sprachmodell-Demonstrator wurde im Rahmen der Initiative des Green-AI Hub Mittelstands entwickelt. Der Green-AI Hub Mittelstand ist eine KI-Initiative des Bundesministeriums für Umwelt, Naturschutz, nukleare Sicherheit und Verbraucherschutz, koordiniert durch die Zukunft – Umwelt – Gesellschaft (ZUG) gGmbH. Der Demonstrator wurde vom Deutschen Forschungszentrum für Künstliche Intelligenz (DFKI) entwickelt.